那天晚上加完班,拖着快散架的身子开车回家。我习惯性地喊了句:“小X,放点歌。”

导航亮了。屏幕上的地图缩放到最大,车机用那个机械的嗓音问我:“您要去哪里?”

“我不是说放歌吗?放!歌!”

“正在附近的加油站,已为您规划三条路线。”

我差点把方向盘拆下来。这种对话,我猜你也没少经历过。以前的语音助手,说白了就是个“关键词匹配机器人”。你说“我有点冷”,它可能给你打开空调,也可能问你“是不是需要导航到最近的医院”。你说“打开雨刮”,它直接给你放一首《雨一直下》。这哪是智能,分明就是“人工智障”。

事情是从什么时候开始变得不一样的?

大概是去年年底,我蹭同事的新车跑了一趟长途,彻底被震住了。当时高速上堵了快一个小时,后排孩子哭得厉害。我同事就嘟囔了一句:“这小家伙是不是想睡了?”话音刚落,你猜怎么着?音响音量自动降到最低,后排遮阳帘慢慢升起,空调温度调高了,连座椅都换成了更软的模式。整个过程安安静静,没人按任何按钮,没人喊任何指令。

我当时心里就一个感觉——这车成精了?后来我才知道,这不是什么玄学,是

说实话,以前的车机语音,真的就是在“画饼”

车企宣传页上吹得天花乱坠——“唤醒率99%”“支持连续对话”“多轮交互”。等你真开上路,发现根本不是那么回事。我记得有一次带我老妈出门,她只会说四川话。她对着车机喊了半天“把窗子梭下来点”,车机毫无反应。她问我:“这车是不是听不懂人话?”我只能尴尬地笑笑,手动摇下车窗。

后来我才知道,普通语音助手本质上就是“关键词触发器”。你必须字正腔圆地说出预设好的指令,它才能听懂。比如你说“空调22度”,它照做;你说“有点闷”,它就傻眼了-10。更离谱的是,有次开车时路边广场舞的音乐把车机唤醒了,它突然来了一句“我在哦”,吓得我差点把方向盘打歪-10。有测评显示,一些高端车型的语音交互成功率能做到98.6%,而我那辆入门合资车,估计连及格线都够不着-10。

但现在的AI,是真的开始“办事”了

今年3月,我看到新闻说阿里千问第一次完整地上车,搭载在红旗的灵犀座舱里-7。这不是单纯的语音助手升级,而是一个真正能“办事”的智能体。你可以说“先去北大,中午找一家沿途的烤鸭店,下午5点前到T3航站楼”,它能同时搞定导航、吃饭、时间规划三个目标-19。它不是你“说一步做一步”,而是自己拆解任务、调用地图、查商家信息,直接给你一个完整的方案。

智己汽车搞的那个IM Ultra Agent更夸张,打通了座舱、智驾、底盘三个领域-2。你跟它说“出来晚了,快开”,它自己规划最短路线,切换运动模式,避开拥堵-2;你说“孩子好像想睡了”,它自己把悬架调软、音响降低、空调调成无风出风-2。还有吉利和阶跃星辰搞的那个“超级Eva”,可以帮你途中订餐、自动泊车-18。这些已经不是“语音助手”了,而是真正的“AI副驾”。

隐私这块儿,说实话我也挺犯怵

说点实在的。现在的AI车载助手越来越聪明,但它记住的也越来越多——你每天几点上班、爱听什么歌、常去哪家咖啡馆、甚至你开车时心情好不好-1。有一次我借了朋友的新车试驾,路过公司楼下那家咖啡店,车机直接问我“要不要来杯平时喝的美式”。贴心吗?贴心。但细想一下,它连我爱喝什么都摸得一清二楚,这事儿你让我不毛骨悚然那是不可能的。

好在这一块车企也越来越重视了。有调查显示,超七成的车主觉得座舱生成的数据应该归自己所有-15。现在很多车支持分级权限管理,你可以单独关掉车内摄像头和麦克风-15。还有些方案直接把AI推理放在本地芯片上跑,数据不用上传云端,从根本上规避了隐私风险-24。所以我的建议是:买车的时候多问一句数据怎么处理的,能不能关掉,做到心里有数。

说到底,汽车正在变成“会移动的家人”

以前我们聊一辆车,聊的是马力、扭矩、百公里加速。现在你再坐进2026年的新车,你会发现大家聊的完全不一样了——“你的车懂不懂你啊”“它会不会帮你办事啊”。我有个开修理厂的朋友说,现在进厂修车的年轻人,第一个问的不是“发动机怎么修”,而是“语音助手能不能修”-1。这变化可真够大的。

车子不再是那个冷冰冰把你从A送到B的金属壳子,它开始学会观察你、照顾你、甚至在你累的时候替你分忧。它不说话的时候,你不觉得尴尬;它开口的时候,说的都是你正好需要的话。这才是真正的智能出行——不是炫技,是让你在路上那段时间,过得舒服一点。

——以下是网友互动问答——

网友“开车爱吐槽”问:我家那台老车也是喊“打开空调”的语音助手,到底能不能升级成这种AI车载助手啊?

这位车友,咱俩握个手,我太理解你这种感受了。我跟你一样,家里那辆旧车也是这种“智障语音”,每次开朋友的新车都觉得自己被时代甩在后面了。不过说实话,老车想直接升级成这种AI智能体,确实不太现实。

我特意去打听了一下这事儿。目前主流的AI智能座舱,靠的不是单纯加个软件补丁那么简单。它背后需要几个硬件层面的支撑:一是高性能的座舱芯片,用来跑大模型推理;二是多麦克风阵列,用来精准拾音和声源定位;三是车内摄像头和传感器,用来感知你和乘客的状态-。这就好比你想让一台老电脑跑最新的AI绘图软件——硬件底子就卡在那了,光靠装个软件,根本跑不起来。

不过也不是完全没有办法。有些后装市场推出了智能车载投影仪或者智能后视镜,集成了第三方的语音助手,虽然做不到整车级的“主动感知”,但起码能让你享受“一句话控制导航、音乐、打电话”这些基础功能。比如某些品牌的智能HUD产品,直接投屏到前挡风玻璃,你喊一声就能设导航、切歌,响应速度也不错。我有个车友群的朋友就装了一个,他说虽然比不上新车那种“懂你心思”的程度,但比原厂那个傻瓜语音强了不知道多少倍。我建议你上某东某宝搜一下“智能车载语音助手”,看看评价,选一个销量高、差评少的试试。花几百块钱,能让老车再战两三年,性价比还是可以的。

网友“四川老陈”问:我爸开车只会说四川话,现在这些新车能不能听懂啊?每次看他开车时对着车机喊半天喊不动,真的心疼。

老陈这个问题问到点子上了,也是很多家庭实实在在的痛点。你放心,现在的AI车载助手,方言这块已经进步太多了。

我给你说几个具体的数字你就明白了。像奥迪E5 Sportback搭载的语音助手,支持四川话、广东话、河南话、东北话等12种主流方言,识别准确率高达98%-30。你老爸要是说“把空调调低点儿,莫太烫”,系统能瞬间执行-30。还有五菱的“灵语座舱”,支持8种方言和12种重口音,识别率超过95%,专门针对中国市场优化过-。iCAR V23就更贴心了,除了常见方言,还新增了温州话、闽南语这些比较小众的方言,识别准确率从88%提到了95%-。温州一位车主分享过,他用家乡话跟车机说“去江心屿”,立马就能精准导航,他父母不会说普通话,现在也能轻松操作车机了-27。

所以老陈你完全不用愁。现在买新车的时候,你可以在试驾环节专门用四川话跟车机对话试试,看看反应速度和准确率。而且现在的方言识别技术已经能做到混合识别的程度了,就算你老爸说的时候带点“川普”,系统也能通过上下文判断出来-30。我建议你下次换车的时候,把“方言识别”作为一个硬性指标来挑,很多国产新势力在这方面做得相当不错。

网友“数据控小刘”问:现在的车载AI能记住我那么多隐私,万一数据泄露了怎么办?我是真的不放心。

小刘你这个担心一点都不过分,我跟你一样的顾虑。车上那么多传感器、摄像头、麦克风,它记住我每天去哪、爱听什么、甚至听到我说了什么话——这事谁心里不犯怵?

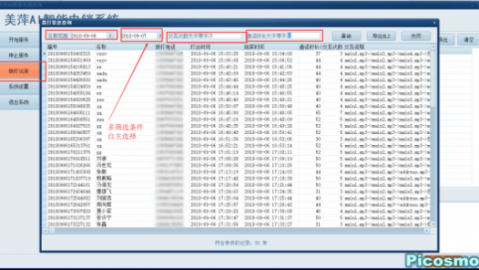

不过别怕,我给你说说现在行业里是怎么解决这个问题的,让你心里有个底。从法律法规层面,去年陕西省消保委的一个调查显示,71.8%的受访者都觉得座舱生成的数据应该归用户自己所有-15。很多车企已经意识到这个问题了,推出了分级权限管理功能,你可以自己在系统里单独关闭车内摄像头、麦克风这些敏感设备-15。换句话说,你觉得它太“聪明”了不舒服,你完全可以关掉它。

技术层面也有很大进步。现在一些车企和供应商采用了“端侧AI”方案,就是把AI推理的算力放在本地芯片上,所有数据在车内本地处理,不需要上传到云端-24。这就相当于你的所有隐私都被锁在车里,车厂自己都看不到。赛轮思和SiMa.ai合作的那个方案就是典型,本地处理隐私零风险。博世也搞了一套“安全通道”验证机制,所有AI决策通过安全通道验证后才执行,一旦检测到异常指令,系统立刻切换到安全模式-14。

所以我给你三条实在的建议:第一,买车的时候多问一句数据处理方式和权限管理,优先选支持本地存储和分级权限控制的车型;第二,提车后第一时间去看看隐私设置,关掉那些你觉得没必要一直开着的传感器;第三,关注一下这家车企的OTA升级和隐私政策有没有持续更新,好的品牌会越做越规范。说到底,技术本身不可怕,怕的是它不听你的。只要你能随时让它“闭嘴”和“忘记”,你就掌握了主动权。