本文带你深入理解AI记忆助手背后的RAG技术、向量数据库与Agent记忆系统,涵盖原理剖析、代码实战与高频面试考点。

你是否遇到过这样的场景:明明ChatGPT刚刚聊过的话题,换个对话窗口就“失忆”了;AI助手看似懂你,换个话题却需要重新交代你的所有偏好;面试中被问到“RAG是什么”,你只记得“检索+生成”,却说不出向量数据库在其中扮演什么角色?这些问题的背后,都指向同一个核心技术——AI记忆系统。 在2026年的今天,AI记忆助手已从简单的对话记录演变为集向量检索、智能压缩、多层级存储于一体的复杂系统,成为大语言模型(Large Language Model, LLM)应用中不可或缺的“外接大脑”。本文将带你从痛点出发,系统拆解记忆助手AI的核心技术栈:RAG(检索增强生成)的工作原理、向量数据库的语义检索机制、以及Agent记忆系统的三大架构范式。无论你是技术入门者、面试备考者,还是正在构建AI应用的开发者,都能在本文学到可落地的知识和可直接背诵的考点。

一、痛点切入:为什么AI需要“记忆助手”?

先看一段没有记忆的AI对话:

模拟无状态AI对话(每次对话独立) def chat_without_memory(user_input): 没有历史记录,每次都从头开始 response = llm.generate(user_input) return response 用户:我叫小明,我喜欢喝冰美式。 好的,了解了。 用户:给我推荐一杯咖啡。 推荐您尝试热拿铁,口感顺滑。(完全忘了用户说喜欢冰美式)

这种“聊完就忘”的体验,根源在于传统大模型存在三大先天缺陷:

上下文窗口限制:即使是最先进的LLM,单次对话能“记住”的Token数量也是有限的。当对话过长,早期的信息就会被自动遗忘-。

无跨会话记忆:每次新开对话,AI都像患了失忆症,需要用户重新交代背景、偏好和历史信息。用网友的话说:“每次关掉对话窗口,一切归零”-。

“幻觉”问题频发:当LLM不确定答案时,往往会“自信满满地胡说八道”,编造不存在的事实。2026年的一项研究表明,这一问题源于模型依赖内部参数记忆知识,而非基于可靠外部证据作答-。

正是这些痛点,催生了记忆助手AI这一技术方向——其核心思路是:不给AI“装大脑”,而是给它配一个“外接笔记本” 。

二、核心概念讲解:RAG(检索增强生成)

标准定义

RAG(Retrieval-Augmented Generation,检索增强生成) 是一种将外部知识库检索能力与大语言模型生成能力相结合的架构。其核心思想是:不依赖模型内部参数记忆知识,而是通过实时检索最相关的外部文档,再由大模型基于这些证据生成准确、可追溯的回答-。

拆解关键词

检索(Retrieval) :从知识库中找到与用户问题最相关的信息片段。

增强(Augmented) :将检索到的信息作为“上下文证据”注入到生成过程中。

生成(Generation) :LLM基于原始问题+检索结果,生成最终答案。

生活化类比

想象你去图书馆找一本你从未读过的书:

传统LLM:像一位只读过教材的学者,考试靠“背答案”,遇到没背过的题就瞎编。

RAG:像一位知道怎么用图书馆检索系统的研究员——先检索书架上的相关书籍(检索),翻到相关章节阅读(增强),再结合自己的理解给出答案(生成)。答案有来源、可追溯、更可信。

RAG为什么在2026年更火了?

2026年,RAG正从简单的“检索-然后-生成”管道,演变为复杂的知识运行时(Knowledge Runtime) 架构——一个综合性的编排层,统一管理检索、推理、验证和治理,其地位类似于Kubernetes之于应用工作负载-。同时,Meta在2026年发布了GraphRetriever系统,将文本嵌入与图遍历能力相结合,有效解决了复杂多跳查询的难题-。

三、关联概念讲解:向量数据库

标准定义

向量数据库(Vector Database) 是一种专门存储和检索高维向量数据的数据库系统。它通过嵌入(Embedding) 技术,将文本、图像、音频等非结构化数据转化为数值向量,并利用近似最近邻(Approximate Nearest Neighbor, ANN)算法实现高效的语义相似性检索。

与传统数据库的对比

| 维度 | 传统关系型数据库 | 向量数据库 |

|---|---|---|

| 检索依据 | 精确关键词匹配(WHERE name = “张三”) | 语义相似度匹配(找“与X意思相近的内容”) |

| 数据类型 | 结构化数据(数字、字符串、日期) | 非结构化数据(文本、图像、音频) |

| 核心操作 | 等值查询、范围查询、JOIN | 相似度检索、Top-K最近邻 |

| 能否“理解”含义 | 不能,只匹配字面 | 能,通过向量距离判断语义相近 |

核心机制:嵌入模型如何工作?

嵌入模型(如Sentence-BERT、CLIP等)可以将任何非结构化数据转换为一个固定长度的向量——通常是768维、1024维甚至更高维度的浮点数组-。神奇之处在于:语义相似的内容,其向量在数学空间中也彼此靠近。 -

嵌入模型的效果示例(伪代码) embedding_model = SentenceBERT() vec1 = embedding_model.encode("苹果很好吃") [0.12, -0.34, 0.78, ...] vec2 = embedding_model.encode("香蕉味道不错") [0.11, -0.33, 0.76, ...] vec3 = embedding_model.encode("今天天气晴朗") [-0.45, 0.21, -0.11, ...] 计算向量余弦相似度 similarity(vec1, vec2) 0.92 → 语义相近 similarity(vec1, vec3) 0.31 → 语义无关

四、概念关系与区别总结

理解RAG与向量数据库的关系,可以用一句话概括:

向量数据库是RAG的“记忆中枢”,RAG是向量数据库的应用场景。

向量数据库提供存储和检索能力——相当于大脑的“海马体”,负责存储和快速提取记忆。

RAG定义了一套完整的检索-增强-生成流程——相当于从“记忆提取”到“回答生成”的完整认知回路。

一句话记忆口诀: “向量数据库管存管找,RAG负责拿来用。”

五、代码实战:从零搭建一个极简RAG系统

以下是一个可直接运行的Python示例,展示RAG的核心工作流程(代码已精简,重点突出关键逻辑):

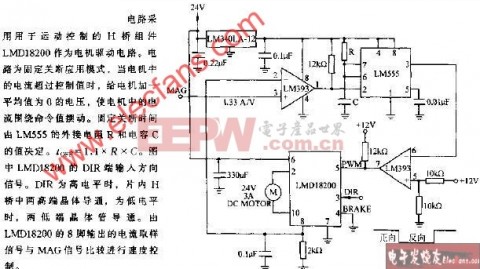

极简RAG示例:让AI基于你的知识库回答问题 from sentence_transformers import SentenceTransformer import numpy as np Step 1: 准备知识库(你的“记忆素材”) knowledge_base = [ "RAG的全称是Retrieval-Augmented Generation,即检索增强生成。", "向量数据库通过嵌入技术将文本转换为高维向量。", "传统数据库只能精确匹配关键词,向量数据库可以按语义检索。" ] Step 2: 加载嵌入模型(将文本转为向量) model = SentenceTransformer('all-MiniLM-L6-v2') 将知识库中的所有文本编码为向量 kb_vectors = model.encode(knowledge_base) Step 3: 接收用户问题,并转为向量 user_query = "什么是RAG?" query_vector = model.encode([user_query]) Step 4: 计算相似度,检索最相关内容 similarities = np.dot(kb_vectors, query_vector.T).flatten() most_similar_idx = np.argmax(similarities) retrieved_context = knowledge_base[most_similar_idx] Step 5: 将检索结果“注入”Prompt,交给LLM生成答案 prompt = f""" 用户问题:{user_query} 参考资料:{retrieved_context} 请基于以上参考资料回答用户问题。 """ 调用LLM生成答案(此处用模拟输出替代) answer = f"根据检索到的资料:{retrieved_context[:30]}..." print(f"检索到的相关记忆:{retrieved_context}") print(f"AI回答:{answer}")

代码执行流程解析:

知识库构建:准备3条知识作为AI的“长期记忆”。

离线嵌入:将所有知识文本转化为向量(类似给每本书贴上“语义坐标”)。

在线检索:用户提问后,将问题也转为向量,计算与知识库向量的余弦相似度,找到最相关的一条-。

增强生成:将检索到的内容拼接到Prompt中,交给LLM生成答案。

关键理解点:这个极简示例中的np.dot相似度计算,在工业级系统中会替换为专业的向量数据库(如Milvus、Chroma、Qdrant)进行高效ANN检索。2026年的向量数据库已支持HNSW、IVF等高级索引算法,能在百万级向量中实现毫秒级检索-。

六、底层原理与技术支撑

RAG与向量数据库之所以能够高效工作,底层依赖三大核心技术:

嵌入模型(Embedding Model) :这是整个技术栈的“翻译官”。它将非结构化数据(文本、图像、音频)转化为固定维度的数值向量,决定了向量的语义表达能力-。常见模型包括Sentence-BERT(文本)、CLIP(图文多模态)。

近似最近邻算法(ANN, Approximate Nearest Neighbor) :面对数百万甚至数十亿维向量,精确计算所有相似度是不现实的。ANN算法(如HNSW、IVF)通过牺牲极小的精度换取巨大的效率提升,将检索时间从O(N)降至O(log N)量级。

向量索引结构:2026年的向量数据库引入了多层索引机制,如HNSW(Hierarchical Navigable Small World,分层可导航小世界图)通过构建多层图结构实现快速导航式检索。

一句话总结底层逻辑:嵌入模型负责“翻译”,向量索引负责“指路”,RAG负责“串联”。

七、高频面试题与参考答案

Q1:请简述RAG是什么?与Fine-tuning的区别是什么?

标准答案:RAG(Retrieval-Augmented Generation)是一种检索增强生成架构,通过实时检索外部知识库为大模型提供上下文证据,再基于这些证据生成回答。与Fine-tuning的区别在于:Fine-tuning将知识注入模型参数(永久改变模型),适合改变模型风格或行为;RAG保持模型不变,动态检索外部知识,适合知识频繁更新、要求答案可溯源的场景。

踩分点:①说出RAG全称;②说明“检索→增强→生成”三步流程;③点明Fine-tuning改参数 vs RAG不改参数的本质差异。

Q2:向量数据库与传统数据库的核心区别是什么?

标准答案:传统关系型数据库基于精确关键词匹配(如WHERE name=“张三”),只能处理结构化数据;向量数据库基于语义相似度检索,通过嵌入模型将文本、图像等非结构化数据转化为高维向量,利用向量距离(如余弦相似度)判断内容相关性。向量数据库是RAG架构中的“记忆中枢”。

踩分点:①关键词匹配 vs 语义检索;②结构化 vs 非结构化;③提到嵌入(Embedding)技术。

Q3:RAG如何解决大模型的“幻觉”问题?

标准答案:RAG不依赖模型内部参数记忆知识,而是强制模型从检索到的外部文档中提取事实依据再生成答案,从而将回答“锚定”在真实证据上,显著降低编造虚假内容的概率。当检索不到相关内容时,模型可以诚实地回答“未找到相关信息”。

踩分点:①“不依赖参数记忆”;②“基于检索证据生成”;③“提高可解释性和可追溯性”。

Q4:向量检索中的ANN算法是什么?为什么需要它?

标准答案:ANN(Approximate Nearest Neighbor,近似最近邻)是一种牺牲微小精度换取大幅效率提升的检索算法。在百万级甚至十亿级向量中,精确计算所有距离(线性扫描)耗时过长。ANN通过构建HNSW、IVF等索引结构,将检索复杂度从O(N)降至O(log N)或O(1),是向量数据库能够支持大规模实时检索的核心技术。

踩分点:①说出ANN全称;②说明“精度换效率”的trade-off;③举出HNSW/IVF等具体算法。

八、结尾总结与预告

本文系统梳理了记忆助手AI背后的三大核心技术:

| 技术概念 | 一句话理解 | 记忆要点 |

|---|---|---|

| RAG(检索增强生成) | 给AI配个“外接知识库”,先查后答 | 检索→增强→生成,三步骤 |

| 向量数据库 | AI的“语义引擎”,按意思找内容 | 嵌入→向量→相似度检索 |

| 底层支撑(嵌入+ANN) | 翻译官(嵌入)+导航员(ANN) | 理解“翻译”和“指路”两个动作 |

重点易错点提醒:①不要混淆RAG和向量数据库——它们是“流程”和“工具”的关系;②不要认为向量数据库能替代传统数据库——两者协同而非替代-;③记住:AI记忆的核心不是存储,而是检索——存得再多,找不到等于没用。

下一篇预告:我们将深入Agent记忆系统的三大架构范式——短期记忆、长期情景记忆与用户画像记忆,结合Mem0、MemMachine等开源框架,手把手带你构建一个真正“越聊越懂你”的AI智能体。敬请期待!

📚 参考资料

[1] Jiuqi Wei et al. “The Virtuous Cycle: AI-Powered Vector Search and Vector Search-Augmented AI.” arXiv, 2026.-

[2] “Advanced Retrieval-Augmented Generation (RAG) System Architectures and Optimization Techniques for 2026.”-

[3] 阿里云开发者社区.“从关键词到语义:向量数据库如何让AI真正理解你的需求.” 2026.-

[4] 阿里云开发者社区.“为什么传统数据库不够用,向量数据库如何补位?” 2026.--

[5] “RAG架构实现:向量检索与大模型融合方案.” 2026.-

[6] MatrixOrigin. “Memoria 开源项目——业内首个‘Git for Memory’ Agent可信记忆框架.” GTC 2026.--

[7] “SuperLocalMemory V3.3: The Living Brain.” arXiv, 2026.-