在2026年AI全面落地的今天,从纸质文档一键转Excel、拍照翻译、甚至让AI自动帮你处理跨APP任务,正成为智能设备的新标配。而这一切的核心——

小米AI扫描助手

小米AI扫描助手是小米科技基于小爱视觉AI能力打造的智能扫描与识别工具,集成于MIUI及澎湃OS系统中,支持文档扫描、OCR文字提取、表格识别、物体识别、翻译等全场景功能,并逐步向AI Agent能力演进-5-。

一、痛点切入:为什么需要AI扫描助手?

传统实现方式通常是这样的——遇到一份纸质文档需要电子化时,你只能逐字敲入电脑;拍了一张表格照片,对着Excel一格一格复制粘贴;看到一份外文菜单,打开第三方翻译APP逐行输入。

传统实现:手动录入 + 调用外部OCR服务 def traditional_way(): 1. 手动拍照保存 2. 打开OCR软件 → 上传图片 → 等待识别 → 复制结果 3. 打开Word/Excel → 粘贴 → 手动调整格式 4. 打开翻译APP → 逐句翻译 → 再次粘贴 pass 缺点:至少5步操作,切换3个以上应用,耗时2分钟+

这种实现方式存在以下痛点:

流程割裂:需要频繁切换应用,无法形成闭环

效率低下:表格场景下仅提取文字不够,还需手动还原电子表格-17

依赖网络:多数OCR服务需联网,离线场景无法使用

格式丢失:传统OCR只输出纯文本,丢失文档结构和表格关系

小米AI扫描助手的出现,正是为了解决这些问题——将拍照→识别→解析→导出整合为一步操作,并支持离线使用-4。

二、核心概念讲解:OCR光学字符识别

OCR(Optical Character Recognition,光学字符识别) 是一种通过模拟人类视觉与语言处理机制,将图像中的文字转化为可编辑电子文本的技术-42。

生活化类比:想象你是一个快速阅读者——先扫视整页找出文字区域,然后逐字辨认书写顺序,最后把认出的文字整理成笔记。OCR正是用算法模拟这个过程。

技术流程三阶段-42:

图像预处理:去噪、二值化、倾斜校正,提升文字清晰度

字符分割:将图像中的文字区域逐一切分,为后续识别做准备

特征提取与匹配:通过算法提取文字形状、笔画等特征,与模板库比对输出结果

小米的实现方案:MIUI系统集成OCR引擎,采用CNN(卷积神经网络)与RNN(循环神经网络)结合的架构,支持中英日韩等50+语言识别,在本地完成计算,减少网络依赖-18。

三、关联概念讲解:AI视觉识别与智能体Agent

AI视觉识别 指通过深度学习模型对图像中的内容进行分类、检测和语义理解,涵盖物体识别、场景理解、文字识别等子领域。

小米AI扫描助手背后支撑着更广泛的AI视觉能力:

支持识别商品、植物、汽车等物体,提供详细信息-5

可同时识别最多10个条码-4

支持中英互译的拍照翻译功能-5

AI Agent(智能体) :2026年小米发布了Xiaomi miclaw,基于MiMo大模型构建的移动端AI智能体,能将自然语言指令自动转化为跨APP的复杂任务执行-。

概念关系:

OCR是感知层:负责“看懂”文字

AI视觉是感知+理解层:负责“看懂”图片内容

AI Agent是行动层:负责“听懂指令+执行任务”

一句话记忆:OCR负责让手机“看到文字”,AI视觉让手机“理解画面”,Agent让手机“替你做事情”。

四、代码示例:接入小米AI视觉能力

4.1 Galaxy Vision Service OCR调用

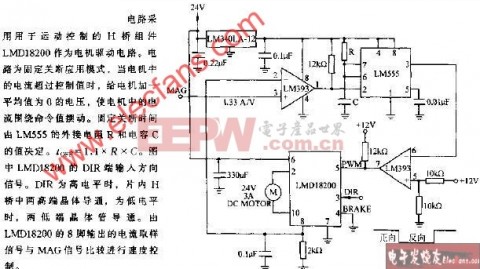

小米Galaxy Vision Service提供OCR识别API,以Python为例-30-20:

from cloud_vision.visionclient import Credential, VisionClient import os 1. 初始化凭证(从小米AI开放平台获取) credential = Credential( galaxy_access_key="YOUR_AK", 你的Access Key galaxy_key_secret="YOUR_SK" 你的Secret Key ) 2. 创建Vision客户端 vision_client = VisionClient( credential=credential, endpoint="cnbj2.vision.api.xiaomi.com" ) 3. 读取图片并调用OCR接口 with open("document.jpg", "rb") as data: content = data.read() image = Image(content=content) ocr_request = OcrRequest(image=image) ocr_result = vision_client.ocr_detection(ocr_request) 4. 解析结果 for region in ocr_result.regions: for line in region.lines: print(f"识别文本: {line.text},位置: {line.boundingBox}") 输出示例: 识别文本: COMPANY NAME,位置: 237,196,164,16 识别文本: GRAPHIC DESIGNER,位置: 184,464,95,8

执行流程说明:

第1-2步:从开放平台获取API凭证并初始化

第3步:将图片数据传入

ocr_detection接口第4步:遍历返回的

regions和lines,提取文本及位置信息

4.2 新旧方式对比

| 维度 | 传统方式 | 小米AI扫描助手方案 |

|---|---|---|

| 操作步骤 | 拍照→打开APP→上传→等待→复制→粘贴 | 拍照→一键识别→导出 |

| 网络依赖 | 多数需要联网 | 支持离线使用 |

| 表格还原 | 仅输出文本 | 自动还原为可编辑Excel |

| 格式保留 | 丢失结构和格式 | 保留文档结构和位置信息 |

五、底层技术支撑

小米AI扫描助手的技术栈主要依赖以下关键技术:

1. 深度学习模型架构

表格检测:采用轻量一阶段检测框架,backbone使用shuffleNetV2,模型大小约1M,可顺畅运行在手机上-17

表格识别:服务端运行,包含文本检测、文本识别、表格结构预测、单元格匹配、对齐算法、Excel导出等模块-17

关键点回归:使用Wing loss代替L1 loss,让表格角点回归更准确-17

2. 端云协同

手机端:负责图像预处理、表格区域检测、透视矫正

服务端:负责复杂表格结构解析和Excel生成

离线方案:核心OCR模型可下载到本地,不依赖网络-5

3. 澎湃OS底层能力

系统级OCR引擎深度集成

支持小爱同学语音控制,与米家APP联动-5

长按手势识别:在任意界面长按文字区域触发识别-16

💡 进阶预告:后续文章将深入解析MiMo-V2全模态模型的架构设计与Agent调度原理。

六、高频面试题与参考答案

Q1:OCR的核心流程是什么?传统OCR和深度学习OCR的主要区别?

参考答案:

核心流程:图像预处理 → 字符分割 → 特征提取与匹配 → 输出识别结果

区别:传统OCR依赖人工设计特征规则,对复杂场景(手写体、模糊、倾斜)识别率低;深度学习OCR(如CNN+RNN)端到端自动学习特征,准确率和鲁棒性显著提升-42

Q2:小米表格识别算法是如何实现图片转Excel的?

参考答案:

技术框架分两层:手机端的表格检测算法 + 服务端的表格识别算法

检测算法定位表格区域和四个角点,通过透视变换矫正为平整表格

识别算法包含文本检测、文本识别、表格结构预测、单元格匹配等模块,最终输出可编辑Excel-17

Q3:小米AI视觉服务提供了哪些主要API接口?

参考答案:

OCR检测(ocr_detection):图片文字识别

标签检测(detect_labels):物体识别(商品、植物、汽车等)

人脸检测与分析(analysis_faces/ match_faces)

NLP翻译(nlp_translation):支持多语言互译-30

Q4:小米AI扫描助手如何保证离线场景可用?

参考答案:

系统级OCR引擎内置在MIUI/澎湃OS中,核心模型本地部署

支持离线语言包下载,无网络环境下仍可完成基础文字识别和翻译

文档扫描、PDF生成等操作均不依赖网络-5-4

七、总结回顾

核心知识点速记:

| 概念 | 一句话定义 |

|---|---|

| OCR | 让计算机“看懂”图片中的文字 |

| AI视觉识别 | 让计算机“理解”图片中的物体和场景 |

| AI Agent | 让AI“替你做”跨APP的复杂任务 |

重点强调:

小米AI扫描助手的技术体系是一个由感知层(OCR)→ 理解层(AI视觉)→ 行动层(Agent) 构成的完整链路

表格识别是其特色功能,核心难点在于表格结构预测和单元格匹配

端云协同设计平衡了手机端性能和识别精度

2026年3月小米发布的MiMo-V2系列模型,正在为扫描助手注入更强大的全模态能力-

易错点提醒:

OCR≠表格识别,表格识别是OCR+结构解析的叠加

离线≠所有功能离线,部分高级识别仍需云端计算

下篇预告:深入解析小米MiMo-V2全模态模型架构与Agent调度原理,敬请期待!