北京时间2026年4月8日|约4500字|阅读约12分钟

一、痛点切入:为什么我们需要AI Agent?

先来看一段传统大模型交互的典型代码:

import openai response = openai.ChatCompletion.create( model="gpt-4", messages=[{"role": "user", "content": "明天北京天气怎么样?"}] ) print(response.choices[0].message.content) 输出可能是:明天北京天气晴朗,气温约20°C——但这段信息可能是“编”的!

这段代码暴露了传统大模型的

知识时效性差:模型训练数据有截止日期,无法获取实时信息。

无法主动行动:模型只会“说”,不会“做”——你能让它描述天气,却无法让它真正调用天气API拿到真实数据。

幻觉问题频发:在没有答案时,模型倾向于一本正经地胡说八道,缺乏“不知为不知”的能力边界。

这些问题限制了AI在真实业务场景中的应用。AI Agent应运而生,它不再满足于“回答问题”,而是要学会“完成任务”。

二、核心概念讲解:AI Agent(智能体)

英文全称:Artificial Intelligence Agent

标准定义:AI Agent是一种能够自主感知环境、独立制订计划、调用工具、执行行动,并在结果反馈中动态调整策略的AI系统-12。

用一句话概括:大模型是“大脑”,AI Agent是“会行动的数字员工” -12。

四大核心特征:

自主目标分解:接收高层指令后,自行拆解为可执行的子任务序列。

工具调用能力:能调用引擎、数据库、API、代码执行器乃至其他AI模型。

闭环行动能力:形成“感知→规划→行动→反馈→修正”的完整自主决策循环。

持久记忆管理:支持跨会话保持上下文贯通,像一个真正“在工作”的角色-12。

技术核心三支柱:

| 支柱 | 类比 | 关键能力 |

|---|---|---|

| 记忆管理 | “大脑” | 工作记忆(当前任务)+ 外部记忆(向量数据库存储) |

| 工具学习 | “手脚” | 工具发现→工具选择→工具对齐,支持MCP等开放协议 |

| 规划推理 | “决策中枢” | 思维链(Chain-of-Thought, CoT)、多步推理、策略迭代 |

-1

一句话理解:传统大模型是“语言生成器”,AI Agent是“任务执行器”。前者回答“怎么做”,后者直接“做到位”。

三、关联概念讲解:RAG(检索增强生成)

英文全称:Retrieval-Augmented Generation

标准定义:RAG是一种将信息检索与文本生成结合的技术框架,核心公式为 RAG = 先检索资料,再让大模型基于资料生成答案 -21。

RAG的出现,本质上是为大模型接入“外部大脑” 。它解决的核心问题是:当模型不知道答案时,先查资料再回答,而不是凭空编造。

RAG的标准流程:

用户提问 → 向量化检索 → 召回相关知识片段 → 构建Prompt → LLM生成答案RAG的核心价值:

知识实时更新:企业知识库更新后,RAG立即生效,无需重新训练模型。

降低幻觉风险:答案基于真实检索内容,可追溯、可信赖。

支持私有数据:企业文档、内部知识库无需暴露给模型训练即可使用。

技术挑战:传统RAG采用“检索一次、生成一次”的静态模式,缺乏多步推理能力,无法处理需要迭代探索的复杂任务-29。

四、概念关系与区别总结:Agent vs. RAG vs. LLM

| 维度 | LLM(大语言模型) | RAG(检索增强生成) | Agent(智能体) |

|---|---|---|---|

| 本质定位 | 能力底座 / 认知核心 | 知识增强机制 | 任务执行系统 |

| 交互模式 | 被动问答 | 检索后回答 | 目标驱动,自主行动 |

| 是否调用工具 | ❌ 否 | ❌ 否(仅检索) | ✅ 是(API/数据库/代码) |

| 是否多步推理 | ❌ 否 | ❌ 否 | ✅ 是 |

| 有无持久记忆 | ❌ 否 | ❌ 否 | ✅ 是 |

| 典型输出 | 文字/代码 | 带引用的答案 | 任务执行结果/成果交付 |

-12-15

一句话高度概括:

LLM是大脑,RAG是给大脑接上的资料库,Agent是一个会使用大脑和资料库去完成任务的“数字员工”。

五、代码/流程示例演示:从零搭建一个Mini AI Agent

下面用Python + OpenAI SDK实现一个最简Agent,具备规划 + 工具调用 + 反思能力。

import json import httpx from datetime import datetime import openai 1. 定义工具(Tools)—— Agent的“手脚” TOOLS = [ { "type": "function", "function": { "name": "get_weather", "description": "查询指定城市的实时天气", "parameters": { "type": "object", "properties": {"city": {"type": "string", "description": "城市名称"}}, "required": ["city"] } } }, { "type": "function", "function": { "name": "get_current_time", "description": "获取当前时间", "parameters": {"type": "object", "properties": {}, "required": []} } } ] 2. 工具的具体实现 def get_weather(city: str) -> str: """调用免费天气API""" resp = httpx.get(f"https://wttr.in/{city}?format=j1", timeout=10) data = resp.json() current = data["current_condition"][0] return json.dumps({ "city": city, "temperature": f"{current['temp_C']}°C", "description": current["weatherDesc"][0]["value"] }, ensure_ascii=False) def get_current_time() -> str: """获取当前时间""" now = datetime.now() return now.strftime("%Y-%m-%d %H:%M:%S") 3. Agent核心循环:规划 → 执行 → 反思 def agent_loop(user_query: str, max_steps: int = 5): messages = [{"role": "user", "content": user_query}] for step in range(max_steps): 步骤1:规划——调用LLM决定下一步动作 response = openai.chat.completions.create( model="gpt-4", messages=messages, tools=TOOLS, tool_choice="auto" ) assistant_msg = response.choices[0].message 检查是否有工具调用需求 if not assistant_msg.tool_calls: 步骤3:反思结束,返回最终答案 return assistant_msg.content 步骤2:执行——调用对应的工具 messages.append(assistant_msg) for tool_call in assistant_msg.tool_calls: func_name = tool_call.function.name args = json.loads(tool_call.function.arguments) if func_name == "get_weather": result = get_weather(args) elif func_name == "get_current_time": result = get_current_time() else: result = f"未知工具: {func_name}" messages.append({ "role": "tool", "tool_call_id": tool_call.id, "content": result }) 继续循环,将工具返回结果交回LLM进行下一步规划 return "达到最大步骤限制,任务未完成" 4. 运行Agent print(agent_loop("帮我查一下明天北京的天气"))

执行流程解析:

规划:LLM识别到用户需要查天气,决定调用

get_weather工具。执行:Agent调用真实API,拿到北京天气数据。

反思:LLM根据工具返回结果,组织自然语言回复给用户。

对比之前的“纯大模型”代码,核心差异在于Agent能够主动调用外部工具获取真实数据,而不是“编”出答案-42。

六、底层原理/技术支撑点

AI Agent之所以能够运行,底层依赖以下几个关键技术:

| 底层技术 | 作用 | 与Agent的关系 |

|---|---|---|

| LLM(大语言模型) | 理解意图、拆解任务、生成决策 | Agent的“大脑”,核心决策单元 |

| Function Calling | 让LLM能够声明“我想调用哪个工具” | 工具调用的标准化接口 |

| 向量数据库 | 存储和检索长期记忆 | 实现Agent的“外部记忆”模块 |

| MCP协议(Model Context Protocol) | AI模型的“USB接口”标准 | 让Agent可以即插即用各种工具和数据源 |

| 思维链(Chain-of-Thought, CoT) | 让LLM展示推理步骤 | 提升Agent规划的可解释性 |

-1-15

一句话理解:Agent = LLM(大脑)+ Function Calling(接口)+ 向量数据库(记忆)+ MCP(标准化连接)。这四层技术栈共同支撑了AI Agent的“感知-规划-行动”闭环能力。

七、高频面试题与参考答案

Q1:LLM和AI Agent的核心区别是什么?

参考答案:LLM(大语言模型)是一个“能力底座”——它擅长理解语言、推理和生成内容,但本身不具备目标意识和执行能力。AI Agent则是在LLM基础上,叠加了规划(Planning)、工具调用(Tool Use)和记忆管理(Memory)的完整系统。核心区别在于:LLM回答“问题”,Agent完成“任务”。LLM是被动的“一问一答”,Agent是主动的“目标驱动”-48。

踩分点:能力底座 vs 完整系统、被动 vs 主动、回答 vs 执行

Q2:RAG和Agentic AI有什么区别?

参考答案:RAG(检索增强生成)是一种“检索→生成”的静态流水线,目的是让LLM基于外部知识回答得更准确。Agentic AI则是一个动态决策系统,Agent可以自主判断何时需要检索、检索什么、检索后是否继续检索、是否需要调用其他工具。一句话概括:RAG改进的是“回答的质量”,Agent决定的是“该回答什么问题、以及如何用行动解决问题”-32-29。

踩分点:静态 vs 动态、信息获取 vs 行动决策、单次检索 vs 迭代探索

Q3:AI Agent的核心能力有哪些?请简述。

参考答案:AI Agent的核心能力包括四个方面:①感知与规划:通过思维链等技术将复杂目标拆解为可执行子任务;②工具调用:通过Function Calling接口调用API、数据库、代码执行器等外部工具;③记忆管理:区分工作记忆(当前任务上下文)和长期记忆(向量数据库存储),支持跨会话状态保持;④自主迭代:在行动后根据反馈自我修正策略,形成“感知→规划→行动→反馈”的闭环-1-4。

踩分点:四支柱齐全、闭环概念清晰、与LLM的区别

Q4:什么是Function Calling?在Agent开发中起什么作用?

参考答案:Function Calling是LLM API提供的一种能力——模型可以输出结构化的函数调用请求(包含函数名和参数),而不是直接输出自然语言文本。在Agent开发中,Function Calling是连接LLM“大脑”与外部“手脚”的关键接口:LLM通过Function Calling声明“我需要调用什么工具、传什么参数”,Agent运行时捕获该请求、执行对应的函数、并将结果返回给LLM继续处理-42。

踩分点:结构化输出、连接大脑与工具、不是直接执行而是声明请求

Q5:多智能体系统(Multi-Agent System, MAS)解决了什么问题?

参考答案:单Agent面临“职责过杂、容易失控”的问题——既要理解需求,又要规划步骤,还要执行动作、整合信息。多智能体系统通过专业化分工来解决:将复杂任务拆解后交由不同专长的Agent协作完成,例如规划者Agent负责拆解任务、执行者Agent负责具体操作、评估者Agent负责结果审核。其优势包括专业化分工、任务并行提速、系统灵活鲁棒-41-10。

踩分点:职责分离、专业化分工、典型的三种架构模式

八、结尾总结

本文系统梳理了AI Agent的核心知识链路:

概念层:LLM是大脑,RAG是知识增强,Agent是任务执行者——三者形成清晰的层次关系。

原理层:Agent的四大核心能力——感知、规划、行动、记忆,构成完整的认知闭环。

实践层:通过极简Python代码示例,展示了Agent“规划→执行→反思”的核心循环。

考点层:LLM vs Agent、RAG vs Agentic AI、Function Calling等高频面试题,建议背诵理解。

重点易错提醒:不要将“多个Prompt拼接”误认为多智能体系统——真正的多智能体必须具备明确的角色分工、状态流转和协作机制-41。

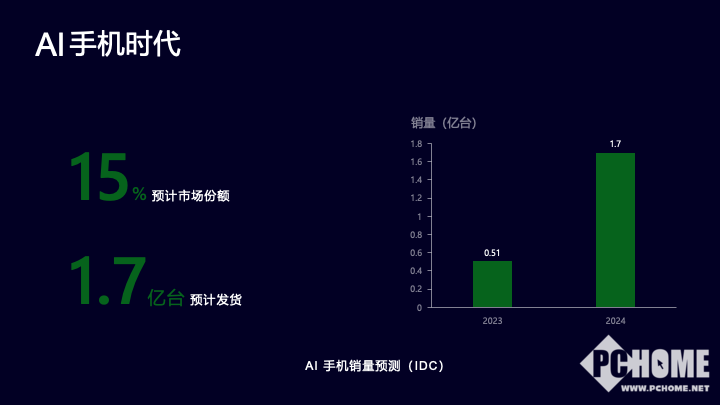

2026年,AI Agent已从技术概念走向千亿级产业-10。下一篇我们将深入多智能体系统的工程化架构与协作模式,敬请期待。

📌 本文要点速记卡

LLM = 能力底座|RAG = 知识检索|Agent = 任务执行

Agent核心能力:规划 + 工具 + 记忆 + 迭代

面试关键:分清“被动问答”与“主动行动”的区别

最小Agent代码:6步循环(规划→工具调用→反思)