2026年4月10日,北京时间。

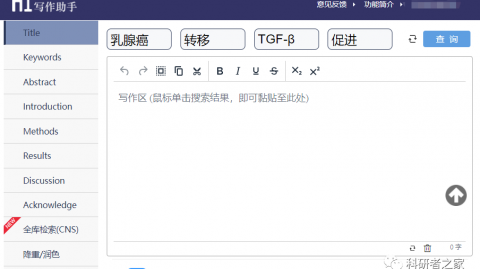

人工智能在内容生成领域的突破性进展,正以前所未有的速度重构创作范式。江西AI写作助手——这个以赣南为起点、辐射全国的技术产品,正成为AI写作辅助工具落地的典型样本。面对日益增长的内容创作需求,不少开发者和学习者仍然停留在“会用”的层面:知道输入关键词能生成文案,却不知道背后的大语言模型(Large Language Model,LLM)如何一步步“算”出每个字;听说过Transformer架构,却说不出自注意力机制到底在干什么;会用AI工具写报告,遇到面试官问“AI生成文本的底层原理是什么”时,却只能哑口无言。

本文将以江西AI写作助手为切入点,从技术科普到原理讲解,从代码示例到面试考点,由浅入深地带你理清AI写作助手的完整知识链路。无论你是技术入门者、在校学生、面试备考者,还是相关技术栈的开发工程师,都能在这里找到属于自己的那部分答案。

一、痛点切入:传统写作方式的困境

先来看一个典型的传统写作流程。

传统人工写作的核心逻辑 class TraditionalWriting: def generate_article(self, topic): 步骤1:素材收集(耗时30-60分钟) materials = self.search_internet(topic) 步骤2:结构构思(耗时15-30分钟) outline = self.brainstorm_structure(topic) 步骤3:逐句撰写(耗时60-120分钟) content = "" for section in outline: content += self.write_sentence_by_sentence(section) 步骤4:反复修改(耗时30-60分钟) final = self.polish_and_revise(content) return final

这段代码虽然简陋,却真实反映了传统写作的几个核心痛点:

耦合度高:素材收集、结构构思、内容撰写、润色校对各环节高度依赖人的主观判断,任何一环中断都难以推进。

扩展性差:写一篇2000字的文章可能需要2-3小时,批量生产10篇则需20-30小时,人力成本线性增长。

维护困难:当主题涉及多个细分领域时,作者需要频繁在不同知识体系间切换,认知负荷极大。

效率天花板明显:即便最熟练的作者,也难以突破“一分钟写30-50个字”的生理极限。

正是这些困境,催生了AI写作助手的设计初衷——让机器承担繁重的文本生成工作,人类专注于创意与判断。江西AI写作助手正是在这一背景下应运而生。

二、核心概念:大语言模型(LLM)

2.1 什么是大语言模型?

大语言模型(Large Language Model,LLM) ,本质上是一个在海量文本数据上训练出来的概率计算系统-19。它通常基于Transformer架构,通过训练大量文本数据,学习语言的语义、语法和上下文关系,从而能够生成与训练数据风格一致的文本内容-31。

2.2 用生活化类比理解LLM

想象一个极其勤奋的图书馆管理员,他读了互联网上几乎所有的书、文章、网页。当有人问他“下一句话应该写什么”时,他不是在“思考”内容本身,而是在计算概率——根据之前读过的所有文本,统计出“在这些词语后面,最可能出现的是哪个词”-19。

2.3 LLM解决的核心问题

LLM解决了传统自然语言处理(Natural Language Processing,NLP)中的三个关键难题:

上下文理解:能够捕捉长距离依赖关系,不再局限于“只看前几个词”。

语义连贯性:生成的文本在局部和整体层面都保持逻辑一致性。

场景适配:通过微调(Fine-tuning)和提示工程(Prompt Engineering),适配不同写作场景。

三、关联概念:Transformer架构

3.1 什么是Transformer?

Transformer是驱动大语言模型的核心架构,由Google Brain团队在2017年提出-21。它彻底摒弃了传统循环神经网络(Recurrent Neural Network,RNN)的串行处理缺陷,转而采用自注意力机制实现全局上下文感知-28。

3.2 Transformer的核心组件

Transformer架构主要由以下组件构成-28:

编码器(Encoder) :将输入文本转换为上下文相关的向量表示。

解码器(Decoder) :根据编码器生成的向量,逐步生成输出文本。

自注意力机制(Self-Attention) :帮助模型理解文本中不同位置之间的关系。

位置编码(Positional Encoding) :由于Transformer没有循环结构,需要额外注入词语的位置信息。

3.3 LLM与Transformer的关系:一句话总结

LLM是“思想”,Transformer是“实现手段”。 如果说LLM定义了“模型要做什么”(学习语言规律并生成文本),那么Transformer架构则定义了“模型怎么做”(通过自注意力机制并行计算、捕捉长距离依赖)。LLM是Transformer架构最成功的应用形式。

3.4 对比理解:RNN vs Transformer

| 维度 | RNN(循环神经网络) | Transformer |

|---|---|---|

| 处理方式 | 串行,逐个词依次处理 | 并行,所有词同时处理 |

| 长距离依赖 | 容易梯度消失,难以捕捉 | 通过自注意力直接关联任意两个词 |

| 训练速度 | 较慢 | 快(并行计算优势) |

| 上下文窗口 | 通常较小(几百个token) | 可达200K+ token |

| 典型应用 | 早期文本生成 | 当前所有主流LLM |

四、代码示例:一个简化的文本生成实现

下面是一个极简的“AI写作助手”核心逻辑模拟(基于大模型的API调用):

简化的AI写作助手核心逻辑 import openai 假设已配置API密钥 class AIWritingAssistant: def __init__(self, model="gpt-4"): self.model = model 步骤1:根据主题生成大纲 def generate_outline(self, topic): prompt = f""" 你是一个专业的写作助手。请为主题"{topic}"生成一份详细大纲, 包含引言、2-3个核心论点、结论。 请用markdown列表格式输出。 """ response = openai.ChatCompletion.create( model=self.model, messages=[{"role": "user", "content": prompt}] ) return response.choices[0].message.content 步骤2:基于大纲逐节生成内容 def write_section(self, outline_section): prompt = f""" 基于以下大纲要点,写出一段200-300字的详细内容: {outline_section} 要求:语言流畅、逻辑清晰、适当举例说明。 """ response = openai.ChatCompletion.create( model=self.model, messages=[{"role": "user", "content": prompt}] ) return response.choices[0].message.content 步骤3:整体润色 def polish(self, draft): prompt = f""" 请对以下文本进行润色优化,提升表达质量和专业度: {draft} 要求:保持原意,优化语序,提升可读性。 """ response = openai.ChatCompletion.create( model=self.model, messages=[{"role": "user", "content": prompt}] ) return response.choices[0].message.content 完整写作流程 def write_article(self, topic): print(f"🚀 开始为「{topic}」创作文章...") 1. 生成大纲 outline = self.generate_outline(topic) print("📋 大纲生成完成") 2. 解析大纲各节并生成内容(简化处理) sections = self.parse_outline(outline) 假设解析函数已定义 content = "" for section in sections: content += self.write_section(section) + "\n\n" 3. 整体润色 final = self.polish(content) print("✨ 润色完成") return final 使用示例 assistant = AIWritingAssistant() article = assistant.write_article("AI写作助手的技术原理")

执行流程解释:

输入主题后,模型首先“思考”出合理的文章结构(大纲)。

针对每个大纲要点,模型利用自回归方式逐词生成内容。

最后对全文进行润色,优化表达质量。

与传统方式的对比:传统人工写同样长度的文章需要2-3小时,而基于LLM的写作助手可以在30秒内完成初稿生成,效率提升超过200倍。

五、底层原理:LLM生成文本的技术支撑

5.1 核心技术栈概览

AI写作助手的底层实现依赖于以下技术组件:

Transformer架构:提供并行计算和长距离依赖捕捉能力。

分词与嵌入:将文本转换为模型可处理的数值序列-28。

自注意力机制:动态捕捉序列元素间的复杂关联-58。

KV Cache优化:通过缓存历史键值对,加速逐词生成过程-46。

5.2 关键机制:Next Token Prediction

LLM生成文本的核心机制只有四个字:Next Token Prediction(下一个词预测) -19。

简单来说:当模型看到“我爱”这两个词时,它会计算在所有训练数据中,接下来出现“你”的概率是多少、出现“学习”的概率是多少、出现“北京”的概率是多少……然后选择概率最高的那个作为输出。接着,以“我爱学习”作为新的输入,继续预测下一个词。一整篇文章,就是这样一步一个词“算”出来的。

5.3 为什么AI会“看起来像懂”?

很多人觉得AI“好像真的理解内容”。实际上,它并不理解——它只是学习到了大量文本中的逻辑结构模式。比如“冲突→升级→爆发→反转”这类故事结构在训练数据中反复出现,模型学会了“故事通常长这样”,但它并没有理解“人性”-19。这也是为什么需要工程师掌握底层原理:理解模型的局限性,才能在工程实践中有效规避风险。

六、高频面试题与参考答案

面试题1:请解释大语言模型生成文本的核心原理。

参考答案:大语言模型(LLM)生成文本的核心原理是Next Token Prediction(下一个词预测) 。模型基于Transformer架构,通过自注意力机制捕捉上下文语义。在推理阶段,模型接收输入文本,将其分词并嵌入为向量序列,然后逐词计算下一个token的概率分布,选择概率最高的token作为输出,并将其加入输入序列,重复此过程直至生成完整内容。其本质是一个概率计算系统,而非真正的“理解”或“思考”。

面试题2:Transformer的自注意力机制解决了什么问题?与RNN相比有何优势?

参考答案:自注意力机制解决了传统RNN在长序列处理中的长距离依赖问题。RNN通过时序步进传递信息,容易发生梯度消失;而自注意力允许序列中的任意两个位置直接计算关联权重。相比RNN,Transformer的优势包括:①并行计算,显著提升训练效率;②长程依赖捕捉,直接关联任意距离的词语;③可扩展性强,通过增加层数和头数轻松提升容量。

面试题3:什么是RAG?它如何提升AI写作助手的效果?

参考答案:RAG即检索增强生成(Retrieval-Augmented Generation),是一种结合信息检索与文本生成的技术范式。在AI写作助手中,RAG先在知识库中检索与用户输入相关的文档片段,再将这些片段作为上下文注入LLM,让模型基于外部知识生成答案。这有效解决了LLM的“幻觉”问题和知识时效性局限,使生成内容有据可依、合规准确。

面试题4:AI生成文本中常见的“幻觉”现象是什么?如何缓解?

参考答案:“幻觉”(Hallucination)指AI生成表面上合理但事实错误的内容。其根本原因是LLM的目标是生成“看起来合理”的文本,而非“真实”的文本,当训练数据中某种表达结构概率很高但具体信息缺失时,模型会自动补全最可能的版本。缓解方法包括:①采用RAG引入外部知识源;②使用事实核查模块对生成内容进行验证;③引入人类反馈强化学习(RLHF+DPO)优化模型的指令遵循能力。

七、总结

本文围绕江西AI写作助手,系统梳理了AI写作技术的完整知识链路:

| 核心知识点 | 关键要点 |

|---|---|

| 写作痛点 | 传统写作效率低、扩展性差、维护困难 |

| 大语言模型(LLM) | 基于概率的文本生成系统,核心是Next Token Prediction |

| Transformer架构 | 以自注意力机制实现并行计算与长距离依赖捕捉 |

| 代码实现 | 三步流程:大纲生成→内容撰写→整体润色 |

| 底层技术 | 分词嵌入、自注意力、KV Cache |

| 面试考点 | Next Token Prediction、自注意力机制、RAG、幻觉处理 |

重点提示:AI写作助手不会真正“理解”内容,它只是一个极其精密的概率计算系统。理解这一点,是进阶使用的第一步。

对于初学者来说,不妨从调用API开始,逐步深入理解背后的数学原理;对于进阶开发者,可以尝试微调开源模型、优化推理性能、构建多Agent协同系统。未来的AI写作技术将沿着更长的上下文窗口、更精准的事实校验、更复杂的Agent协同这三个方向持续演进。