北京时间:2026年4月9日

在容器化技术深度渗透云原生生态的当下,Docker 已从单纯的容器运行时引擎进化为集成 AI 能力的智能开发平台。2026 年,Docker AI 助手——即 Docker 官方推出的 AI 智能助手 Gordon——正成为开发者与运维人员提升效率的核心利器。许多容器用户长期面临“只会用 Docker 命令、不懂自动化运维原理、概念易混淆、面试答不出”的困境。本文将带你从零理解 Docker AI 助手的概念体系,理清逻辑,看懂代码,掌握考点,建立完整的知识链路。

一、痛点切入:为什么需要 Docker AI 助手?

在 Docker AI 助手出现之前,开发者和运维人员处理容器相关任务的方式相当原始:

传统运维流程示意:

传统方式:手动排查容器故障 docker ps -a 查看所有容器状态 docker logs <container> 拉取日志文件,人工逐行翻阅 docker inspect <container> 检查配置详情 凭经验判断问题 → 手动修复或重启

传统方式的痛点:

效率低下:凌晨三点生产容器崩溃,你需要被唤醒后 SSH 登录、拉日志、查错误、搜方案,一套流程走完至少 20 分钟-10。

自动化缺失:传统监控工具如 Prometheus、Grafana 能告诉你“出问题了”,但不会告诉你“为什么出问题”以及“怎么修”-10。

知识门槛高:Docker、Kubernetes、Docker Compose 各自独立操作,脚本编写成本高,不同工具之间来回切换。

重复劳动:同样的故障反复发生,每次都需要人工介入。

Docker AI 助手的应运而生,正是为了解决上述问题。 Docker 公司在 Docker Desktop 中内置了 AI 助手 Gordon,旨在将 AI 能力直接注入容器开发生命周期,实现从“被动救火”到“主动智能运维”的跃迁--26。

二、核心概念讲解:Docker AI 助手(Gordon)

标准定义:

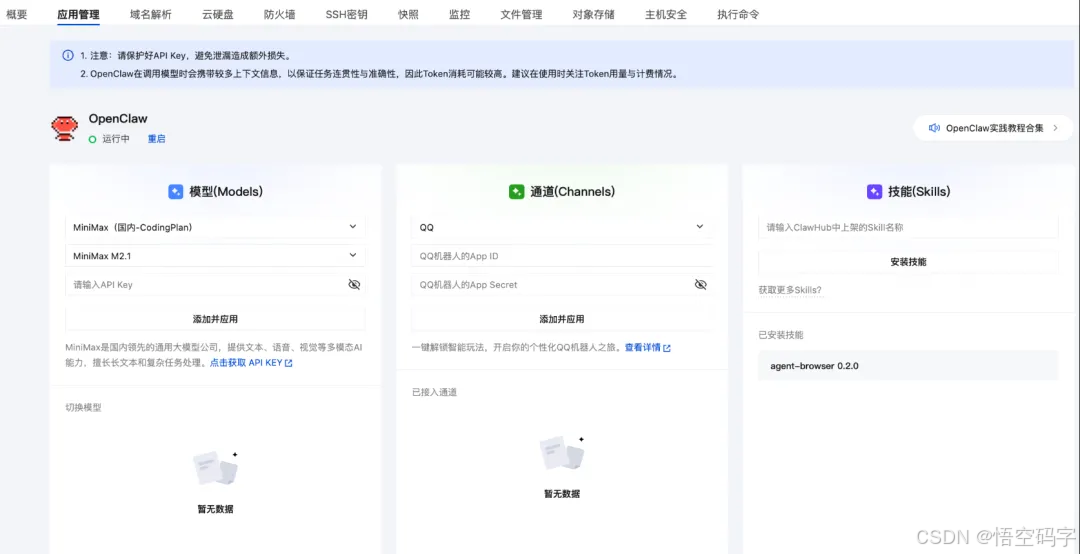

Docker AI 助手(也称 “Ask Gordon” 或 Gordon)是 Docker 官方内置在 Docker Desktop 中的智能 AI 代理,具备调试修复、应用容器化、Docker 操作执行和环境优化等能力,运行于本地环境-20-26。

拆解关键词:

AI 代理:基于大语言模型(LLM)的智能体,能够理解自然语言指令并执行具体操作。

内置集成:随 Docker Desktop 一起交付,无需额外安装,开箱即用。

本地运行:所有操作在本地完成,不将敏感数据上传云端。

上下文感知:能够理解你的项目结构、Dockerfile、Compose 文件等上下文信息。

生活化类比:

可以把 Docker AI 助手理解为“容器世界的自动驾驶系统”。就像智能汽车能自动感知路况、规划路线、规避障碍一样,Gordon 能够自动分析容器状态、排查故障原因、执行修复操作。你只需告诉它“目的地”(例如“帮我容器化这个 Python 项目”),剩下的路由、加速、变道全部由它完成。

核心价值:

Docker AI 助手解决了开发者与容器运行时之间的“语言隔阂”——你不再需要记住冗长的 docker 命令参数和 YAML 配置语法,用自然语言就能完成复杂任务,从而将注意力集中在业务逻辑本身。

三、关联概念讲解:MCP(Model Context Protocol,模型上下文协议)

标准定义:

MCP(Model Context Protocol,模型上下文协议)是一种开放协议,旨在将外部系统能力标准化为“工具(Tool)”,供 AI 模型统一调用不同的数据源或服务-。MCP 服务器向 AI 客户端暴露一组工具、资源和提示词,AI 客户端可以按需调用这些能力-。

MCP 与 Docker AI 助手的关系:

MCP 是 Docker AI 助手实现外部能力扩展的底层通信协议。Docker AI Agent 扮演 MCP 客户端角色,可以连接以容器形式运行的 MCP 服务器-4。换句话说:

Docker AI 助手是“大脑”——负责理解用户意图、做出决策。

MCP是“神经网络”——负责将大脑的指令传递给外部工具和数据源。

MCP 服务器是“手脚”——执行具体操作(如拉取 GitHub 代码、查询数据库、操作 Kubernetes)。

MCP 的运行机制示意:

用户输入 "帮我清理无用的 Docker 镜像" ↓ Docker AI Agent(MCP 客户端)解析意图 ↓ 查找工作目录中的 gordon-mcp.yml,识别可用的 MCP 服务器 ↓ 调用对应的 MCP 服务器 → 执行 docker image prune 操作 ↓ 返回清理结果给用户

📌 在 Docker Desktop 中,输入 docker ai 命令后,Agent 会在当前目录查找 gordon-mcp.yml 配置文件,据此识别该上下文下应使用的 MCP 服务器-20。

四、概念关系与区别总结

| 维度 | Docker AI 助手(Gordon) | MCP(模型上下文协议) |

|---|---|---|

| 角色定位 | AI 智能体(执行者) | 通信协议(连接器) |

| 所属层级 | 应用层 | 协议层 |

| 功能职责 | 理解意图、执行操作、提供建议 | 标准化 AI 与外部工具的连接方式 |

| 运行方式 | 运行在 Docker Desktop 中 | 作为协议标准,由 MCP 客户端和服务器共同实现 |

| 使用门槛 | 自然语言交互,零门槛 | 需要配置 gordon-mcp.yml 文件 |

一句话记忆口诀:

Docker AI 助手是“管家”,MCP 是“管家和各个服务部门之间的通话协议”。

五、代码 / 流程示例演示

示例一:使用 Docker AI 助手自动容器化应用

假设你有一个 Python Flask 项目,想要生成 Dockerfile 和 docker-compose.yml:

在项目根目录执行 docker ai 在弹出的 AI 对话窗口中输入: > 帮我容器化这个 Python Flask 应用 Gordon 会自动分析: 1. 检测项目结构和依赖文件(requirements.txt / pyproject.toml) 2. 识别使用 Python 3.11,框架为 Flask 3. 生成优化的 Dockerfile 4. 生成配套的 docker-compose.yml 和 .dockerignore 5. 输出 README 说明如何使用

背后发生了什么?

Gordon 扫描项目文件结构 → 识别开发语言和框架 → 调用内置的容器化模板引擎 → 生成符合最佳实践的 Docker 资产文件-20。

示例二:自然语言管理容器

docker ai > 找出并清理所有未使用的镜像 Gordon 自动执行: - 调用 Docker API 列出所有镜像 - 标记无任何容器引用的镜像 - 执行 docker image prune 并返回清理结果

执行效果: 无需记忆 docker image prune -a 等复杂命令,自然语言即可驱动容器管理-4。

示例三:智能故障诊断(对比)

传统方式:

1. 容器异常退出后手动查看状态 docker ps -a | grep Exited 2. 拉取全部日志 docker logs myapp --tail 100 3. 人工扫描日志定位 error/exception 关键词 4. Google 错误信息找解决方案 5. 手动修复并重启容器 docker restart myapp

⏱️ 耗时:约 10-20 分钟

使用 Docker AI 助手 + MCP 智能诊断:

docker ai > 分析 myapp 容器为什么崩溃了 Gordon 自动完成: - 拉取容器最后 50 行日志 - 通过 MCP 协议调用诊断工具 - 返回根因分析和修复建议

⏱️ 耗时:约 10-30 秒-11

六、底层原理 / 技术支撑

Docker AI 助手的智能能力建立在以下底层技术之上:

| 底层技术 | 作用 | 对应层级 |

|---|---|---|

| 大语言模型(LLM) | 理解自然语言指令,生成结构化响应 | 智能决策层 |

| MCP(模型上下文协议) | 标准化 AI 与外部工具/数据源的连接 | 通信协议层 |

| Docker Engine API | 执行具体的容器管理操作(启动/停止/删除/日志拉取) | 执行层 |

| Kubernetes API | 管理 K8s 资源(命名空间、服务、Pod 日志分析) | 扩展执行层-4 |

| 本地文件系统访问 | 读取项目代码、配置文件,生成 Dockerfile | 数据层 |

简要说明:

用户输入自然语言指令 → LLM 解析语义意图

意图通过 MCP 协议转换为标准化的工具调用

调用 Docker Engine API 或 K8s API 执行具体容器/K8s 操作

结果通过协议原路返回给用户

这一架构使得 Gordon 既能理解复杂的业务上下文,又能安全地执行底层操作,而用户始终无需接触 API 细节。(底层源码解析将在后续进阶文章中展开。)

七、高频面试题与参考答案

Q1:Docker AI 助手是什么?和传统的 Docker CLI 有什么本质区别?

参考答案:

Docker AI 助手(Gordon)是 Docker 官方内置的 AI 智能代理,能够理解自然语言指令并自动执行 Docker 操作、生成 Dockerfile、诊断故障等。与传统 CLI 的核心区别在于:CLI 是“指令执行器”,用户必须精确知道命令和参数;而 Gordon 是“意图理解器”,用户只需描述想要的结果,AI 自动完成从意图解析到指令执行的完整链路。本质上是从“人懂机器”到“机器懂人”的范式转变。

Q2:什么是 MCP?它在 Docker AI 助手中起什么作用?

参考答案:

MCP(Model Context Protocol,模型上下文协议)是一种开放协议,用于标准化 AI 应用程序与外部工具、数据源之间的连接方式。在 Docker AI 助手中,Docker AI Agent 扮演 MCP 客户端角色,通过 MCP 协议调用运行在容器中的 MCP 服务器,从而执行如拉取 GitHub 项目、查询数据库、操作 Kubernetes 等任务。简单说,MCP 是 Docker AI 助手实现“能力扩展”的桥梁。

Q3:Docker AI 助手可以做什么?请列举 3 个典型使用场景。

参考答案:

自动容器化应用:扫描项目代码,自动生成优化的 Dockerfile、docker-compose.yml 和 .dockerignore。

智能故障诊断:自动拉取容器日志,利用 LLM 分析根因,给出修复建议甚至自动修复。

自然语言管理:通过自然语言指令(如“清理未使用的镜像”)驱动容器和镜像的生命周期管理,无需记忆 CLI 命令。

Q4:Docker AI 助手的底层原理是什么?

参考答案:

底层采用“LLM + MCP + Docker Engine API”三层架构:用户输入自然语言 → LLM 解析意图 → 通过 MCP 协议转换为标准化工具调用 → 调用 Docker Engine API 或 Kubernetes API 执行具体操作 → 返回结果。这一架构的关键在于 MCP 作为标准化通信协议,将 AI 的能力从“对话”延伸至“操作”。

Q5:Docker AI 助手的数据安全如何保障?

参考答案:

Gordon 默认在本地运行,所有日志分析、代码扫描、故障诊断都在用户本地环境完成,不将敏感数据上传至云端。MCP 服务器同样可配置为本地运行模式。Docker 官方也提供企业级访问控制(Registry Access Management)和密钥管理等安全机制-23。

八、结尾总结

本文核心知识点回顾:

| 知识点 | 核心要点 |

|---|---|

| Docker AI 助手 | 官方内置 AI 代理,支持自然语言驱动容器管理 |

| Gordon | Docker AI 助手的正式名称,首发于 Docker Desktop v4.61 |

| MCP | 标准化 AI 与外部工具的通信协议,Docker AI 助手的能力扩展桥梁 |

| 适用场景 | 自动容器化、智能故障诊断、自然语言管理 |

| 底层架构 | LLM + MCP + Docker Engine/K8s API |

重点强调:

⚠️ Docker AI 助手 ≠ 自动生成 Dockerfile 的工具——它是具备全链路智能运维能力的 AI 代理。

⚠️ MCP ≠ Docker 专有协议——它是开源标准,Docker 率先将其产品化落地。

进阶预告:

下一篇我们将深入 Docker MCP Catalog 与 MCP Toolkit,解析如何构建生产级的 Agentic AI 应用,以及 Docker Model Runner 如何让大模型在容器中“跑起来”。敬请关注!