大家好啊,我是你们的老朋友,一个在代码世界里摸爬滚打、经常被各种API搞到头秃的野生程序员。今天咱们不聊那些高大上的虚头巴脑的东西,就来摆一摆实实在在的龙门阵——关于那个让又爱又恨的 本地AI接口代理地址。

事情是这个样子的。上个月不是手头紧嘛,看着那些个大模型厂商的账单,心里头那是拔凉拔凉的。特别是用那个Cursor或者VS Code里的各种AI插件,写几行代码,问几个问题,那Token就跟流水似的往外淌。我有个兄弟伙,在重庆一家创业公司,他们老板抠得很,舍不得开会员,就指着那点儿免费额度过日子。结果嘞?每次用到关键时刻,啪!额度没了,界面卡死,气得他差点把键盘锤烂。

我就在想,这龟儿问题到底出在哪儿?后来我琢磨透了,咱们很多时候是直接把API密钥裸奔在客户端,或者每次请求都要跨过千山万水去敲人家的付费大门。这不仅慢,还容易因为网络波动或者IP限制被卡脖子。这就好比你想吃碗正宗的小面,非要打个飞的去重庆,而不是在家门口开个分店,你说是不是傻?

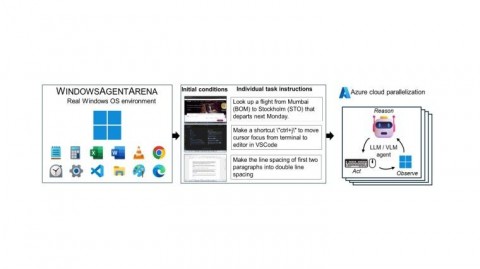

所以嘞,我就开始研究,怎么在自家屋头(也就是本地电脑或者内网服务器)搞一个“中转站”。这个中转站,就是咱们今天聊的本地AI接口代理地址。它的作用就跟个二传手一样,咱们本地的软件、脚本,都找它要数据,它再去跟那些个OpenAI、DeepSeek、豆包啥的去沟通。这样一来,不仅响应速度快了(特别是配上本地缓存),最关键的是,咱们可以把那些个敏感的API密钥藏在这个代理后面,再也不怕写代码时候一不小心把密钥传到GitHub上被人薅羊毛了。

第一步:先搞明白,这玩意儿到底能治啥病?

最开始我也觉得麻烦,心想不就是改个Base URL的事儿吗?至于这么大动干戈?后来发现,至于,太至于了!你不搞个代理,遇到问题的时候那叫一个抓瞎。

比如说,你写代码写得好好的,突然AI不说话了,或者报一个“Timeout”错误。你根本搞不清是网络断了,还是人家服务商挂了,还是你的密钥被限制了。这时候,如果你面前有一个本地AI接口代理地址在运行,你只需要看一眼代理的日志,立马就能定位问题:哦,原来是每秒请求次数超限了,代理自动帮我排队了;或者是某个模型返回的内容太长了,被代理截断了。这种掌控感,才是真真切切的安全感。

我之前在阿里云开发者社区看到一篇文章,讲那个OpenClaw(外号“小龙虾”)的省钱大法 -9。里头提到一个叫qmd的技能,能在本地建个知识库索引,问问题的时候只把相关的片段发给大模型。这一下就给我整开窍了!这其实就是代理干的事啊!它不单单是转发请求,它还能在中间做手脚,比如把上下文中重复的东西砍掉,或者把超长的历史记录压缩一下 -9。这哪里是代理,这分明是个智能管家嘛!

第二步:实战演练,搞个Higress要得不?

说干就干,咱们也不整那些虚的。对于咱们这种懒得造轮子的人,直接上开源方案是最安逸的。我最近在捣鼓Higress AI网关,这东西是真滴方便,阿里系出来的,文档全,社区也热闹 -1。

咋个装?简单得很,打开你的命令行工具(别跟我说你不会,好歹也是玩AI的),复制粘贴这一串:

curl -sS https://higress.cn/ai-gateway/install.sh | bash跑起来之后,浏览器打开 http://localhost:8001,设置个管理员密码。进去之后,你就可以在界面上把各家大模型的API-KEY都填进去,什么OpenAI、通义千问、DeepSeek,统统丢进去 -1。

这时候,你的本地AI接口代理地址其实就是 http://localhost:8080(默认可能是8080)。以后你所有软件的API地址都改成这个,是不是感觉瞬间清爽了?而且Higress里头有个功能我特别喜欢,叫“令牌降级”。意思就是,假如你给OpenAI配置了5个Key,其中一个因为调用太猛被封了,Higress会自动把请求切换到其他好的Key上,保证你的业务不中断 -1。这他娘的才是人工智能啊,自己会看病,自己会吃药!

还有那个监控面板 -1。以前花钱花得稀里糊涂,现在好了,哪个模型花得多,哪个模型响应慢,在面板上一目了然。就跟看水电费账单似的,心里有数。你可以看着那些柱状图,摸摸下巴,琢磨着:“嗯,这个月的钱又都让GPT-4给赚去了,下次得省着点用。”

第三步:进阶玩法,这玩意儿还能搞点啥骚操作?

你以为代理就是转发一下请求?格局小了!真正的骚操作在后面。

比如,你可以像Envoy AI Gateway那样,直接在启动的时候绑定本地的Ollama -10。什么意思呢?就是你可以在本地跑一个Llama 3或者Qwen 2.5的小模型,然后在代理层面配置路由规则。让那些简单的、不需要动脑子的活儿(比如“总结一下这段文字”),直接走本地免费的Ollama;只有那些真正烧脑的编程任务,才发给收费的GPT-4。这样一来,一个月能省下一顿火锅钱。

命令大概长这样,你看懂那个意思就行:

OPENAI_BASE_URL=http://localhost:11434/v1 OPENAI_API_KEY=unused aigw run然后你的代理就跑起来接管一切了 -10。

再比如,那个Helicone AI Gateway,也是类似的思路,它能把100多种模型接口统一成一个OpenAI的格式 -5。这对于开发应用的人来说简直不要太爽。你今天用OpenAI,明天想换成Claude,只需要在代理的配置文件里改一行字,应用端的代码动都不用动。懒,才是程序员的第一生产力!

我还试过那种更野的路子,就是用LiteLLM做本地代理,然后远程去租Vast.ai上的廉价GPU -4。你想啊,你那台破笔记本电脑,显存就6G,跑个7B的模型都费劲。但通过这个代理,你本地起一个服务,所有的计算都扔到云端那个拥有24G显存的怪兽机器上去跑。跑完结果再传回来。本地就起个转发作用,那体验,丝般顺滑,而且成本只有那些大厂的五分之一 -4。

说实话,自从我把这一套玩意儿搞明白之后,我那个重庆的兄弟伙再也不抱怨老板抠门了。他现在上班第一件事,就是启动他那个配置好的本地AI接口代理地址,所有的请求都走本地缓存和过滤,原来一天能用掉10美元额度,现在一个月都用不完10美元。用他的话说就是:“现在用AI,就跟用自家水电一样,想开就开,想关就关,再也不用心惊肉跳怕超额了。”

所以你看,在这个AI工具满天飞的时代,学会搭一个本地代理,不仅仅是省钱的問題,更是一种对自己数据、对自己工作效率负责的态度。它就像给房子装了道防盗门,给车子装了个好减震,用过之后,你就再也回不去了。

好了,啰嗦了这么多,我知道你们肯定还有具体想问的。下面我就化身几个不同的网友,咱们再来摆一哈具体的细节。

网友“代码敲到手抽筋”问:

“大佬,你说得这么热闹,但我看那Higress还要装Docker,我电脑是Windows 10,配置也不高,会不会跑不起来?还有没有更简单、更傻瓜一点的代理软件,我就想在我自己电脑上用用,不想搞那么复杂。”

答:哎呀,兄弟伙,你这个问题问到点子上了,也是好多新手的第一道坎。Windows用户确实有更简单的玩法哈。 你先莫慌到上Higress那个大家伙,对于个人电脑,尤其是配置不是特别高的,咱们先搞个轻量级的。

我给你推荐一个思路,不一定非要装那些带界面的大网关。你看过那个llm-proxy没得?-6 或者直接用Envoy AI Gateway的命令行版aigw run -10。这些玩意儿轻啊!

具体操作呢,你先装个Python或者Node.js环境(这个应该都有吧),然后用pip或者npm装个小工具。比如用那个aigw run,你只需要打开命令行(CMD或者PowerShell),敲一行命令,设置好环境变量就行:

set OPENAI_API_KEY=你的OpenAI密钥 aigw run

看到没?它就起来了,默认监听在localhost:1975 -10。然后你电脑上的任何软件,比如ChatBox、NextChat这些,在设置里把API地址改成http://localhost:1975,模型填gpt-3.5-turbo,它就自动走你这个本地代理了。

如果你的目标是省錢,想混用本地Ollama和云端GPT,那就更简单了:

set OPENAI_BASE_URL=http://localhost:11434/v1 set OPENAI_API_KEY=随便填(比如unused) aigw run

这样,你的代理就直接指向你电脑上的Ollama了 -10。是不是比搞个K8s集群简单多了?你那个Windows 10跑这个绝对没问题,就是开个命令行窗口的事儿,资源占用可以忽略不计。你先用这个轻量的玩熟了,觉得有必要再上Higress那种功能更全的,稳当些!

网友“甲方爸爸改需求”问:

“技术原理我大概懂了,但我最关心的还是安全性。我把所有API密钥都存在这个本地代理里,万一我电脑中病毒了,或者有人偷我电脑,那这些密钥不就全泄露了吗?有没有什么加固的办法?”

答:这位兄弟一看就是被社会毒打过的,安全意识很强,给你点个赞!你说的这个问题确实存在,本地代理虽然避免了网络传输和代码硬编码的风险,但存储安全就成了新的短板。不过,办法总比困难多,咱们可以搞个“三重保险”。

第一层:环境变量剥离。 绝对不要在配置文件里明文写你的API密钥!你看那些专业的部署方案,比如Envoy AI Gateway,它支持从环境变量读取配置 -10。咱们可以把密钥设置在操作系统的环境变量里,比如 OPENAI_API_KEY=sk-xxxxx,代理启动时去读取环境变量。就算配置文件被人看到了,里面也只有${OPENAI_API_KEY}这种占位符,看不到真实密钥。

第二层:加密存储。 如果你用的代理软件不支持环境变量,或者你需要管理的密钥太多,那就得用加密工具。比如,你可以用Ansible Vault或者简单的GPG工具,把配置文件加密成一个文件。每次启动代理之前,手动解密,加载到内存里。虽然麻烦点,但安全性高出一大截。或者像Higress这种,它本身有管理后台,你登录后台需要密码,API密钥在数据库里虽然是存的,但只要你能保证服务器登录密码和管理后台密码足够复杂,也算一道防线 -1。

第三层:网络隔离与最小权限。 你这个本地代理,监听地址千万别设成 0.0.0.0! 只在本地监听 127.0.0.1 -10。这样,只有你这台电脑上的程序能访问它,局域网里的其他设备都访问不了,更别说外面的黑客了。再配合操作系统的防火墙,把代理用的端口(比如8080)只允许本机访问,那就稳如老狗了。做到这三步,基本可以防住99%的日常风险。

网友“今天也想摸鱼”问:

“博主,看你文章里又是Higress又是Envoy的,感觉都是给程序员用的。我是做产品运营的,平时也就用用AI写文案、做做表。你说的这个本地代理地址,对我这种非技术人员有啥实际好处?我直接开个网页版用不香吗?”

答:嘿,你可别觉得这玩意儿只是程序员的玩具,对你这种重度内容创作者来说,用好了简直是提升生产力的神器!

我给你举个例子,你平时用ChatGPT写文案,是不是经常遇到“同一个问题问两遍,它给你回答两遍,浪费时间和Token”?这时候,代理的缓存功能就派上大用场了。

你想啊,你在本地搭一个像Helicone或者Higress这样的代理,把网页版的请求也通过本地代理转发(虽然操作上稍微麻烦点,但可以通过一些浏览器插件实现)。这些代理都带一个功能叫“语义缓存” -1-5。什么意思呢?比如你问“帮我写一个关于夏天喝汽水的朋友圈文案”,过一会儿你同事问“夏天到了,想发个朋友圈推销汽水,咋写?”,这两个问题在语义上高度相似。代理检测到之后,直接把第一次的答案从本地缓存里调出来给你,根本不需要再去请求OpenAI的服务器。

结果就是:响应速度从几秒变成零点几秒,同时,这次请求不花钱! 对于那些高频的、重复性的工作(比如写周报模板、做活动策划框架),缓存带来的节省可不是一星半点。有数据显示,配合适当的缓存策略,Token消耗能降低70%-90% -9。

再比如,你平时要用好几个AI工具,写文案用GPT,做翻译用DeepL,查资料用Claude。每个工具都要登录,都要记住不同的风格。如果你有一个统一的本地AI接口代理地址,你可以把它配置成一个“万能接口”。你只需要在一个界面(比如支持自定义API的第三方客户端)里设置好这个本地地址,它就能根据你选的“模型名”(比如你选“gpt-4”就代表走OpenAI,选“claude-sonnet”就走Claude),自动帮你把请求分发到正确的服务商那里 -5。你就再也不用开四五个网页标签来回切换了,在一个窗口里,用统一的对话界面,调用所有的AI,这效率不蹭蹭往上涨?

所以你看,非技术人员用代理,不是为了折腾代码,而是为了用更少的钱,更快的速度,在一个地方,调用全世界的AI。这不比你一个个网页点开方便多了?